ต้องบอกว่ามาแรงจริงๆ สำหรับ Google Pixel 2 สมาร์ทโฟนจากกูเกิลที่ขึ้นชื่อว่ากล้องดีในระดับท็อปๆ ของมือถือทั้งหมด โดยตอนนี้มีข้อมูลใหม่ที่ไม่ถูกพูดถึงบนเวทีเปิดตัวเลย แต่กูเกิลเพิ่งเปิดเผยเรื่องนี้กับสื่อว่าที่จริงแล้ว Pixel 2 มีชิปประมวลผล (SoC) ถึง 2 ชุดด้วยกัน คือชิปเซ็ตหลัก Snapdragon 835 และ SoC อีกชุดเรียกว่า Pixel Visual Core ใช้สำหรับการประมวลผลภาพถ่ายโดยเฉพาะ

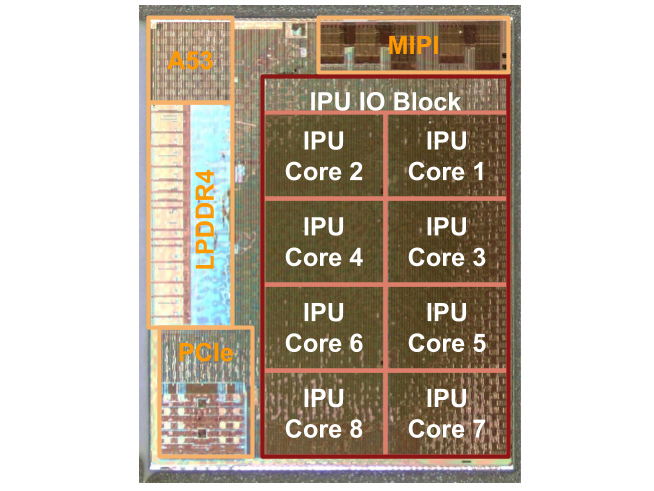

ชิป Pixel Visual Core นี้ถูกออกแบบและพัฒนาโดยกูเกิลเอง ประกอบไปด้วยซีพียู Cortex A53 1 คอร์, แรม LPDDR4 ไม่ระบุความจุ, บัส PCIe สำหรับติดต่อกับตัวเครื่อง และหน่วยประมวลผลภาพ (Image Processing Unit - IPU) ถึง 8 คอร์ที่สามารถประมวลผลได้มากกว่า 3 ล้านล้านคำสั่งต่อวินาที โดยกูเกิลระบุว่าสามารถประมวลผลภาพถ่าย HDR+ ได้เร็วกว่าซีพียูหลักถึง 5 เท่า และใช้พลังงานน้อยกว่า 1 ใน 10 เสียอีก (อันนี้ถือว่าแก้ปัญหาได้ตรงจุด เพราะ Pixel รุ่นแรกใช้เวลาหลายวินาทีกว่าจะโปรเซสภาพ HDR+ เสร็จ)

อย่างไรก็ตาม ขณะนี้ Pixel Visual Core ยังไม่ถูกใช้งาน แต่จะเริ่มใช้ใน Android 8.1 Developer Preview ที่จะปล่อยออกมาในอนาคต อีกทั้งจะเปิดให้แอพของนักพัฒนาเข้าถึงอัลกอริทึม HDR+ ได้ด้วย แปลว่ารูปที่ถ่ายจากแอพอื่นๆ เช่น Instagram, WhatsApp ฯลฯ จะถ่ายได้สวยเท่าแอพ Google Camera นั่นเอง เท่านั้นยังไม่พอ กูเกิลบอกว่า Pixel Visual Core ถูกออกแบบมาสำหรับการประมวลผลภาพที่ยากมากๆ รวมถึงการประมวลผล Machine Learning ด้วยเช่นกัน และขณะนี้กำลังเตรียมใช้งานชิปนี้กับงานอื่นๆ นอกเหนือจากการประมวลผลรูปถ่ายจากกล้องด้วย

ที่มา - Ars Technica

on

on

ตอน DxOMark

zyzzyva Wed, 18/10/2017 - 08:49

ตอน DxOMark ประเมินนี่ได้ใช้ชิพนี้มั้ย มีการกั๊ก Hissatsu ไว้อีก

อย่างไรก็ตาม ขณะนี้ Pixel

lingjaidee Wed, 18/10/2017 - 08:53

In reply to ตอน DxOMark by zyzzyva

เข้าใจว่าชิพนี้ช่วยเรื่องเวลา

olan16 Wed, 18/10/2017 - 13:01

In reply to ตอน DxOMark by zyzzyva

เข้าใจว่าชิพนี้ช่วยเรื่องเวลาในการประมวลผลนะครับ ส่วนคุณภาพยังเหมือนเดิม

นี่ขนาดยังไม่ใช้ชิพยังได้ 100

xestz Wed, 18/10/2017 - 08:59

นี่ขนาดไม่ใช้ชิพยังได้ 99 คะแนน

จากข่าวผมว่าความสามารถของตัวซ

nrml Wed, 18/10/2017 - 09:05

In reply to นี่ขนาดยังไม่ใช้ชิพยังได้ 100 by xestz

จากข่าวผมว่าความสามารถของตัวซอฟท์แวร์รวมถึง AI น่าจะเอามาใช้งานแล้วตั้งแต่แรก การใช้ชิพน่าจะเพียงช่วยลดเวลาในการประมวลผลมากกว่า ซึ่งถ้าถึงเวลาที่เปิดให้ใช้งานก็อาจจะไม่มีความต่างมากเท่าไหร่ในเรื่องคุณภาพของภาพ

เปิดให้ใช้

Aize Wed, 18/10/2017 - 16:17

In reply to นี่ขนาดยังไม่ใช้ชิพยังได้ 100 by xestz

เปิดให้ใช้ น่าจะหมายถึงให้นักพัฒนาทั่วไปใช้งานได้ครับ ในส่วนของกูเกิลน่าจะใช้งานมันอยู่แล้ว เหมือนของ iOS ที่เพิ่งจะเปิดให้นักพัฒนาสามารถใช้งานฟังชั่น ML/AI ได้

ถ้าเปลี่ยนเลนส์ได้

pit Wed, 18/10/2017 - 09:11

ถ้าเปลี่ยนเลนส์ได้ มิลเลอร์เลสคงสั่นสะเทือน.

ไม่ต้องเปลื่ยนเลนส์

menu_dot Wed, 18/10/2017 - 09:47

In reply to ถ้าเปลี่ยนเลนส์ได้ by pit

ไม่ต้องเปลื่ยนเลนส์ แต่คุณภาพเท่า mirrorless นี้สิน่ากลัวของจริง

เสียค่าเลนส์ไปเท่าไหร่แต่ละคน

พอดีเห็นพูดถึงเรื่องค่าเลนส์

langisser Wed, 18/10/2017 - 12:45

In reply to ไม่ต้องเปลื่ยนเลนส์ by menu_dot

พอดีเห็นพูดถึงเรื่องค่าเลนส์

ณ ตอนนี้ผมว่าคุณภาพยังไม่ได้ไปไกลกว่าเลน kit นะครับ แต่เทียบเท่าน่าจะพอได้ ปรกติผมจะบอกว่าถ้าซื้อกล้องมาแล้วจะ auto กับไม่ซื้อเลนส์เพิ่มก็ให้ใช้มือถือคุณภาพดีๆ แทนดีกว่า

แต่ถ้าจะเทียบกับกล้องที่ไม่ใช้เลนส์ kit ผมว่ามันเร็วไปครับ

จริงถ้าเทียบกล้องใหญ่ เจอขนาด

TeamKiller Wed, 18/10/2017 - 14:07

In reply to พอดีเห็นพูดถึงเรื่องค่าเลนส์ by langisser

จริงถ้าเทียบกล้องใหญ่ เจอขนาด Sensor ผมว่ามันก็ต่างกันเยอะแล้วนะครับ ไม่ต้องเทียบ Lens เลยด้วยซ้ำ

จะมี Google Camera

mementototem Wed, 18/10/2017 - 09:45

จะมี Google Camera แบบเป็นกล้องจริง ๆ ออกมาไหม?

นี่ขายมือถือหรือขายกล้องคอมแพ

errin Wed, 18/10/2017 - 09:48

นี่ขายมือถือหรือขายกล้องคอมแพคกัน

น่าสนใจจริง ๆ ครับ สำหรับผม

Krit04 Wed, 18/10/2017 - 09:58

น่าสนใจจริง ๆ ครับ สำหรับผม ที่เลือกมือถือ โดยมองจากกล้องเป็นปัจจัยอันดับต้น ๆ ดูตัวนี้ให้ความสำคัญที่กล้องเยอะมาก คุณภาพภาพที่ได้นี่ ชนะกล้องคู่ได้ รุ่นหน้าถ้าออกมาเป็นกล้องคู่ด้วยนี่อาจมีลังเล (Apple ทำอะไรหน่อยสิครับ เห็นปีนี้กล้องดีขึ้นมา พอเทียบเคียงกับเจ้าอื่นได้หน่อย ปีหน้า 2018 ขอ AI นะครับ แบบเรียนรู้การปรับภาพได้ ทุกวันนี้ยังต้องมาโปรเซสภาพเองเกือบทุกภาพอยู่เลย)

Mate 10 วัดกันไหวมั้ยครับ

impascetic Wed, 18/10/2017 - 09:59

Mate 10 วัดกันไหวมั้ยครับ ในเรื่องของ AI

อยากรู้เหมือนกัน จีนจะสู้

menu_dot Wed, 18/10/2017 - 10:06

In reply to Mate 10 วัดกันไหวมั้ยครับ by impascetic

อยากรู้เหมือนกัน จีนจะสู้ google ไหงไหม

แต่อนาคตผมว่าไหวแน่ huawei พัฒนาเร็วมาก

4 ปี ก่อนยังเป็นแค่ มือถือจีนไม่มีคนรู้จักอยู่เลย มาปีนี้ ทำ Ai แข่ง Google แล้ว

แนวโน้มกล้องปีหน้าจะเป็นยังไง

darkleonic Wed, 18/10/2017 - 11:35

แนวโน้มกล้องปีหน้าจะเป็นยังไงนะ

กล้องหลัง 4 ตัวครับ ปกติ

GyM Thu, 19/10/2017 - 11:26

In reply to แนวโน้มกล้องปีหน้าจะเป็นยังไง by darkleonic

กล้องหลัง 4 ตัวครับ ปกติ ขาวดำ เทเล ไวด์

รอ mate 10 เปิดตัวก่อนนี่เอง

john dick Wed, 18/10/2017 - 11:58

รอ mate 10 เปิดตัวก่อนนี่เอง ถึงค่อยพูด

รอฝากญาติที่อยู่เมกาซื้อให้เล

zerocool Wed, 18/10/2017 - 16:28

รอฝากญาติที่อยู่เมกาซื้อให้เลยดีกว่าแบบนี้

อยากได้การประมวลผลภาพดีๆแบบนี

confused Wed, 18/10/2017 - 17:11

อยากได้การประมวลผลภาพดีๆแบบนี้มาใส่กะ mirrorless จังเลย

โดยเฉพาะของ sony

ยิ่งเห็นยิ่งอยากได้

pexza Wed, 18/10/2017 - 18:03

ยิ่งเห็นยิ่งอยากได้ แต่คงไม่มีตังค์ซื้อ เฮ้ออออออ

อยากได้ แต่ราคาแพงมาก

deargerous Wed, 18/10/2017 - 20:24

อยากได้ แต่ราคาแพงมาก แพงกว่า Iphone X แถม cpu gpu ความเร็วก็ยังต่างกันมากๆ

CPU Single-Core ฝั่ง Android

DashoIISO Thu, 19/10/2017 - 00:11

In reply to อยากได้ แต่ราคาแพงมาก by deargerous

CPU Single-Core ฝั่ง Android ตาม Apple อยู่ครึ่ง ๆ ฮะ

แต่ GPU Adreno ใน Snap ฝั่ง Apple ก็ตามอยู่ครึ่ง ๆ เช่นกัน