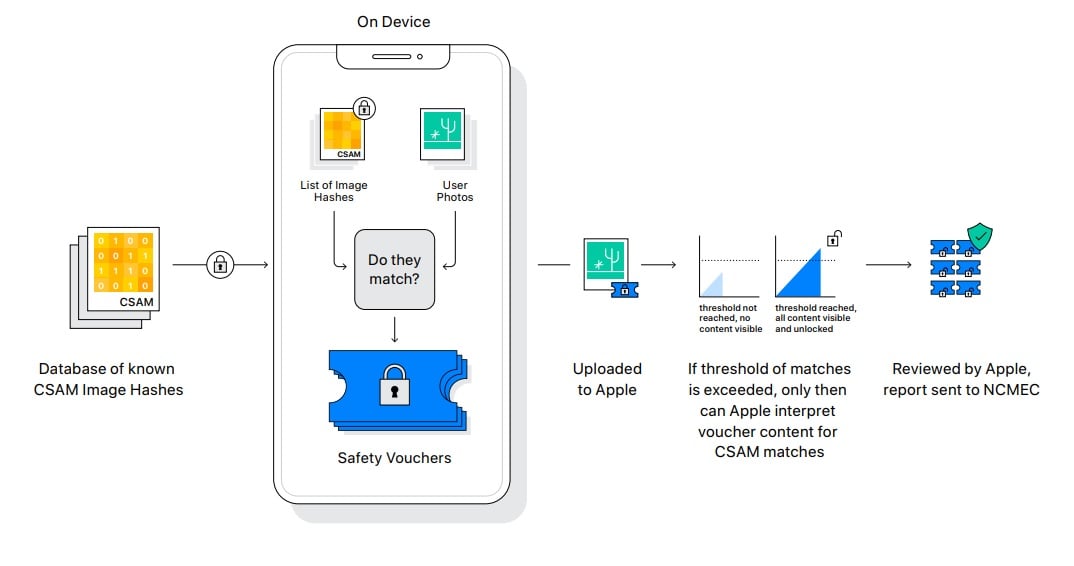

เมื่อปีที่แล้วแอปเปิลระบุว่ากำลังเตรียมอัพเดต iOS ให้สแกนภาพโป๊เด็กในอุปกรณ์ของผู้ใช้ก่อนอัพโหลดขึ้น iCloud และถูกวิจารณ์อย่างหนักว่านำโค้ดตรวจสอบพฤติกรรมผู้ใช้ไปรันบนอุปกรณ์ที่ผู้ใช้เสียเงินซื้อมาเอง วันนี้ทาง WIRED ก็ระบุว่าแอปเปิลหยุดโครงการนี้ไว้แล้ว และหันไปทุ่มทรัพยากรกับการดูแลความปลอดภัยในการสื่อสาร (Communication Safety) แทน

นับแต่แอปเปิลเปิดเผยแนวทางการวิเคราะห์ข้อมูลบนโทรศัพท์ผู้ใช้โดยตรงโดยอ้างว่าว่าจะวิเคราะห์เฉพาะภาพที่กำลังอัพโหลดขึ้น iCloud เท่านั้น ก็ถูกวิจารณ์อย่างหนักเป็นวงกว้าง หลังจากเปิดแนวทางมาไม่กี่เดือนก็ต้องลบข้อมูลออกจากเว็บ แม้ว่าตอนนั้นโฆษกของแอปเปิลยังยืนยันว่าแนวทางยังเหมือนเดิมก็ตามที แต่หลังจากผ่านมาหนึ่งปีตอนนี้แอปเปิลก็ยืนยันแล้วว่าหยุดโครงการนี้ไปแล้ว

ฟีเจอร์ Communication Safety เป็นฟีเจอร์อีกตัวที่ไม่เกี่ยวข้องกับการสแกนภาพโป๊เด็กนักแม้จะดูแลปัญหาคล้ายกัน โดยฟีเจอร์นี้เปิดให้ผู้ปกครองเปิดใช้งานเอง และแจ้งเตือนเมื่อเด็กในความดูแลพยายามส่งภาพโป๊ออกจากโทรศัพท์ โดยเป้าหมายในอนาคตคือทุกแอปจะใช้ API ตรวจจับภาพเหมือนกัน ทำให้ป้องกันเด็กที่ใช้โทรศัพท์ได้ครอบคลุม

ที่มา - WIRED