ช่วงนี้แนวคิด Edge Server หรือการตั้งเซิร์ฟเวอร์ประมวลผล AI ที่ปลายทาง (แล้วค่อยส่งขึ้นคลาวด์) กำลังมาแรง เราเริ่มเห็นโซลูชันจากหลายๆ บริษัทออกสู่ตลาด เช่น ฮาร์ดแวร์ Coral ของกูเกิล, ซอฟต์แวร์จากไมโครซอฟท์, คอมพิวเตอร์อุตสาหกรรมของ Lenovo เป็นต้น

NVIDIA ในฐานะผู้สร้างหน่วยประมวลผลจีพียูสำหรับงาน AI ก็ไม่พลาดสงครามนี้เช่นกัน ล่าสุดเปิดตัว NVIDIA EGX โดยเรียกตัวเองว่าเป็น "GPU Edge Server"

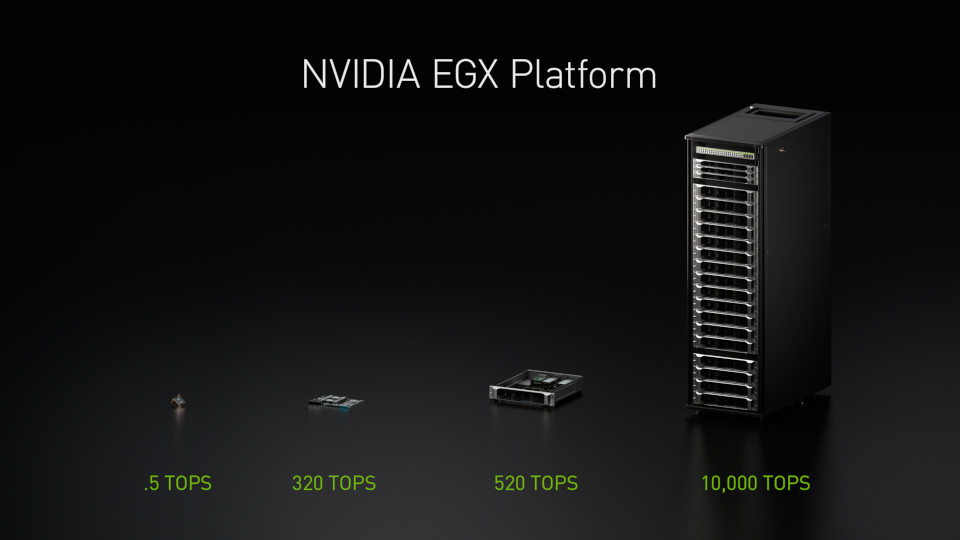

ในแง่ของฮาร์ดแวร์ มันใช้หน่วยประมวลผลของ NVIDIA ยกชุด โดยรุ่นเล็กสุดคือ NVIDIA Jetson Nano บอร์ดประมวลผล AI ขนาดเล็กที่เพิ่งเปิดตัวเมื่อเร็วๆ นี้ มีกำลังประมวลผล 0.5 TOPS (trillion operations per second) แต่ถ้าต้องการเพิ่มกำลังประมวลผล ก็สามารถอัดขึ้นไปได้ถึงตัวใหญ่สุดคือ NVIDIA Tesla T4 ที่มีกำลังประมวลผล 10,000 TOPS

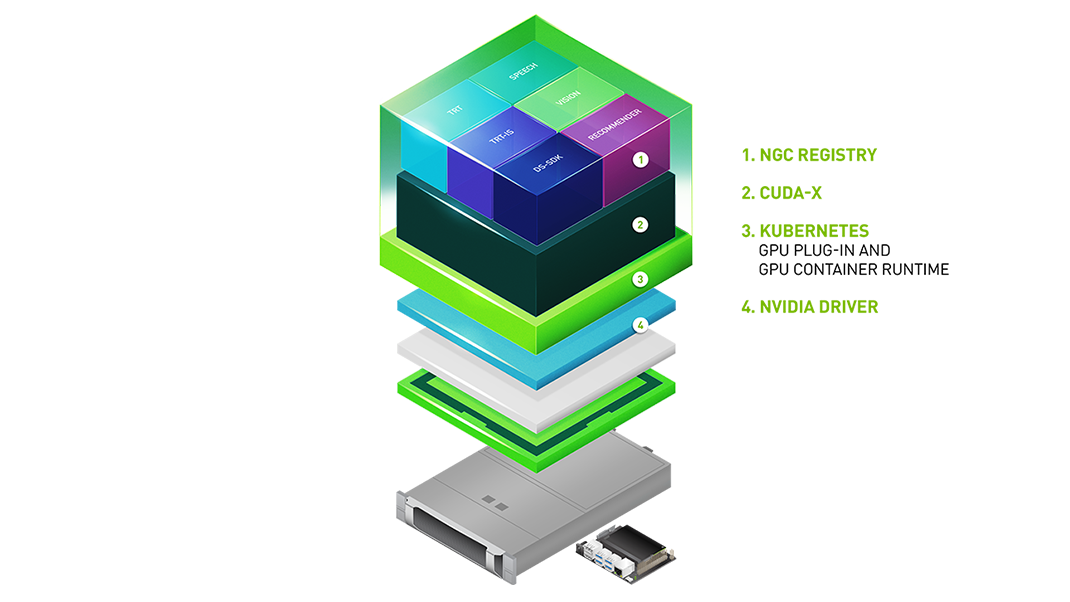

ในแง่ของซอฟต์แวร์ เซิร์ฟเวอร์ EGX รันมิดเดิลแวร์ของตัวเองชื่อ NVIDIA Edge Stack (ซึ่งทำงานบน Red Hat OpenShift อีกทีหนึ่ง) เป็นโซลูชันคอนเทนเนอร์ Kubernetes ที่ประมวลผลข้อมูลบน CUDA และส่งต่อข้อมูลจาก EGX ขึ้นไปบนคลาวด์หลายยี่ห้อ เช่น AWS IoT Greengrass หรือ Microsoft Azure IoT Edge

NVIDIA ไม่ได้ขายเซิร์ฟเวอร์ EGX โดยตรง แต่สร้างต้นแบบให้ผู้ผลิตเซิร์ฟเวอร์นำไปพัฒนาเป็นเซิร์ฟเวอร์ของตัวเองต่อ ซึ่งก็มีผู้ผลิตเซิร์ฟเวอร์ชื่อดังๆ เข้าร่วมครบทุกราย ไม่ว่าจะเป็นรายใหญ่อย่าง Cisco, Dell EMC, Fujitsu, HPE, Lenovo และผู้ผลิตเซิร์ฟเวอร์ขนาดเล็ก/อุปกรณ์ IoT อีกจำนวนหนึ่งด้วย

ที่มา - NVIDIA

Comments

ไม่มี Server จาก Huawei หรอเนี่ย ฮ่าๆ

sever ประเภทนี้ เอาไว้ใช้งานอะไรรึครับ

อีกหน่อยคงมี AI ประจำบ้าน